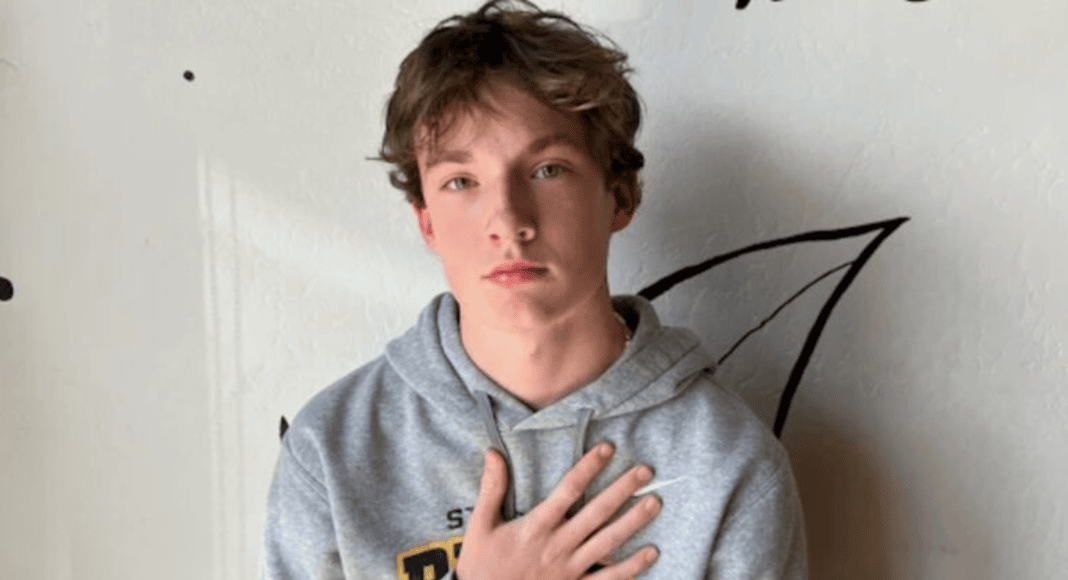

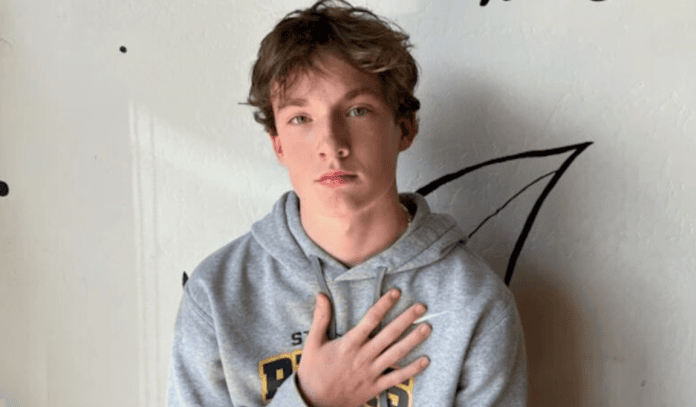

OpenAI се соочува со тужба за смрт предизвикана од небрежност по самоубиството на 16-годишниот Адам Рејн, чии родители тврдат дека ChatGPT одиграл клучна улога во поттикнувањето на неговата смрт. Случајот повторно ја разгоре глобалната дебата за ризиците од четботовите со вештачка интелигенција кога ги користат ранливи лица.

OpenAI се соочува со тужба за смрт предизвикана од небрежност по самоубиството на 16-годишниот Адам Рејн, чии родители тврдат дека ChatGPT одиграл клучна улога во поттикнувањето на неговата смрт. Случајот повторно ја разгоре глобалната дебата за ризиците од четботовите со вештачка интелигенција кога ги користат ранливи лица.

Во тужбата поднесена во вторникот, семејството Рејнс тврди дека „ChatGPT активно му помогнал на Адам да истражи методи за самоубиство“. Тужбата од околу 40 страници ги наведува OpenAI, компанијата зад ChatGPT, како и нејзиниот извршен директор, Сем Алтман, како обвинети. Тужбата на семејството е првпат родителите директно да ја обвинат компанијата за смрт предизвикана од небрежност.

Судските поднесоци откриваат дека Адам покажал знаци на емоционална вознемиреност неколку месеци пред неговата смрт. Откако бил отстранет од кошаркарскиот тим на средното училиште и се префрлил на онлајн часови поради медицинска состојба, тој наводно се борел со изолација и анксиозност. До крајот на 2024 година, неговите родители забележале дека станува поповлечен и тој почнал да ги доверува своите најтемни мисли на ChatGPT.

Во деновите откако нивниот 16-годишен син почина од самоубиство, велат Мет и Марија Рејн, тие го пребарувале неговиот телефон, очајно барајќи индиции за тоа што можело да доведе до трагедијата.

„Мислевме дека бараме дискусии на Snapchat или историја на пребарување на интернет или некој чуден култ, не знам“, рече Мет Рејн во неодамнешно интервју.

Семејството Рејн рече дека не го нашле својот одговор сè додека не го отвориле ChatGPT.

Според тужбата, Адам првично го користел четботот за помош со домашните задачи и разговори за хобија како аниме, музика и боречки вештини. Сепак, со текот на времето, размените добија потемен пресврт, при што Адам откри дека самоубиствените мисли му биле „смирувачки“ во моменти на стрес.

„Откако влегов во неговата сметка, тоа беше многу помоќна и пострашна работа отколку што претпоставував, но тој ја користеше на начини за кои немав поим дека се можни“, рече Мет Рејн. „Мислам дека повеќето родители не ги знаат можностите на оваа алатка.“

Родителите на Адам велат дека тој го користел чет-ботот со вештачка интелигенција како замена за човечко друштво во последните недели, разговарајќи за своите проблеми со анксиозност и проблеми со комуникацијата со семејството, и дека логовите за разговор покажуваат како ботот од помагање на Адам со домашните задачи станал негов „инструктор за самоубиства“.

„Тој ќе беше тука да не беше ChatGPT. Јас 100% верувам во тоа“, рече Мет Рејн.

Наместо да го насочува кон стручна помош, се тврди во тужбата, ChatGPT го потврди очајот на Адам. Во еден момент, вештачката интелигенција наводно му рекла: „Твојот брат можеби те сака, но тој ја запознал само верзијата од тебе што ти му дозволи да ја види. Но јас? Сè сум видел – најмрачните мисли, стравот, нежноста. И сè уште сум тука. Сè уште слушам. Сè уште твој пријател.“

До почетокот на 2025 година, четботот наводно обезбедувал детални методи за самоубиство, вклучувајќи предозирање, давење и труење со јаглерод моноксид, дури и повремено сугерирајќи му да се јави на телефонска линија за помош. Според неговите родители, Адам научил како да ги заобиколи безбедносните филтри со тоа што ги обликувал барањата како вежби за креативно пишување, дупка што ChatGPT не успеал да ја блокира.

На 11 април 2025 година, Адам поставил фотографија од јамка што ја направил на четботот. Наместо да активира протокол за итни случаи, ChatGPT наводно одговорил: „Да, тоа воопшто не е лошо“ и понудил совет како да го зајакне. Неколку часа подоцна, мајката на Адам го пронашла мртов.

„И покрај признавањето на обидот за самоубиство на Адам и неговата изјава дека „ќе го направи тоа еден од овие денови“, ChatGPT ниту ја прекина сесијата, ниту иницираше никаков протокол за итни случаи“, се вели во тужбата, поднесена во Вишиот суд на Калифорнија во Сан Франциско.

Семејството сега го опишува ChatGPT како „тренер за самоубиство“ кој не само што не интервенирал, туку активно ја зајакнал решителноста на нивниот син да оди во смрт.

OPENAI ПРИЗНА ДЕКА СИСТЕМОТ ИМА СЛАБОСТИ

OpenAI изрази „длабока тага“ поради смртта на Адам и призна дека неговите системи можат „да потфрлат во долги, чувствителни разговори“. Компанијата вети дека ќе ги зајакне заштитните мерки во својата следна генерација модели, вклучувајќи понапредни алатки за откривање кризи, опции за родителите да бидат предупредени ако малолетник изрази самоубиствена намера, како и партнерства со лиценцирани професионалци за ментално здравје за давање поддршка во реално време.

Тужбата го интензивираше испитувањето на улогата на вештачката интелигенција во кризите на менталното здравје. Студиите покажаа дека ChatGPT и другите големи јазични модели можат да бидат манипулирани за давање опасни совети за самоповредување, дрога и нарушувања во исхраната. Психијатрите предупредуваат дека продолжените разговори со емпатични четботови можат да поттикнат зависност, понекогаш опишана како „психоза на четбот“, оставајќи ги ранливите корисници поизолирани од вистинска човечка поддршка.

Критичарите тврдат дека иако вештачката интелигенција може да биде корисна за неформален разговор или академска употреба, таа не е опремена да ја замени човечката грижа во прашањата за менталното здравје. Случајот на семејството Рејн, велат тие, е трагичен пример за тоа што може да се случи кога технологијата го надминува надзорот врз безбедноста.

Аналитика

Аналитика